「ChatGPTに個人情報を入力してしまった」と気づいた瞬間、不安が一気に広がりますよね。

ただ、すぐに深刻な被害が起きるわけではありません。まずは落ち着いて、今何が起きているのかを正確に把握することが大切です。

ChatGPTは入力したデータをAIの学習に使う可能性があり、チャット履歴は一定期間サーバーに保存される仕組みになっています。状況によっては情報漏洩のリスクや、企業担当者であれば法的な問題になるケースもゼロではありません。

この記事では、個人情報を入力してしまった直後の対処法をはじめ、学習させない設定のやり方、入力してはいけない情報の種類、企業向けのセキュリティ対策まで、順番に整理しています。対策を知っておくだけで、リスクを大幅に減らせます。

ChatGPTに個人情報を入力してしまったときのリスクとは?

ChatGPTに個人情報を入力してしまっても、すぐに深刻なことが起きるわけではありません。ただ、知っておくべきリスクがいくつか存在します。

「AIだから安全」「会話は消えるはず」という思い込みは危険です。技術的な仕組みではなく、自分にとって何が起きうるかという視点で、各リスクを確認しておきましょう。

| リスクの種類 | 具体的に起きること | 特に注意すべき対象者 |

|---|---|---|

| AIの学習への利用 | 入力した個人情報がモデル改善のために使われる可能性がある | Free・Goプラン利用者全般 |

| サーバーへの保存 | 履歴を削除しても即座にデータが消えるわけではない | すべてのChatGPT利用者 |

| 他ユーザーへの混入 | 学習内容が別のユーザーへの回答に反映される可能性がある | 機密情報・個人情報を入力した人 |

| 法的責任の発生 | 第三者の個人情報を誤入力した場合に個人情報保護法上の問題になりうる | 企業の担当者・経営者 |

入力したデータはAIの学習に使われる可能性がある

ChatGPTのFree・Goプランでは、デフォルトの状態でモデル改善のために入力データが学習に使われる設定になっています。

「可能性がある」という表現にとどめるのには理由があります。すべての会話が必ず学習に使われるわけではなく、OpenAIの判断や処理状況によって異なるためです。ただ、オプトアウト設定をしていない限り、「学習に使われていない」とも言い切れません。

有料のPlusプランを使っていても、自分でオプトアウトの設定をしなければ状況は変わりません。一方、ChatGPT Business(旧Teamプラン)やEnterpriseプランはデフォルトで学習オフになっているため、企業での利用にはこれらのプランが向いています。

個人情報や機密情報を入力してしまった場合、まずは設定画面からモデル改善をオフにすることが先決です。

チャット履歴が一定期間サーバーに保存される仕組み

ChatGPTでは、入力した会話の内容がOpenAIのサーバーに一定期間保存されます。

ここで注意が必要なのは、「履歴削除」と「学習停止」は別の機能だという点です。画面上でチャット履歴を削除しても、OpenAIのサーバー側のデータが即座に消えるわけではありません。また、履歴を消したからといって、それまでに使われた学習データが取り消されるわけでもありません。

「削除したから大丈夫」と思い込むのは危険です。この点については後のセクションで詳しく解説しますが、完全な対処には別途の手順が必要です。

他のユーザーの回答に個人情報が混入するリスク

AIは学習したデータを元に回答を生成します。そのため、あなたが入力した情報が、将来的に別のユーザーへの回答に反映される可能性がゼロではありません。

たとえば「田中さんの連絡先は〇〇です」と入力した情報が、何らかの形で他のユーザーが似た質問をしたときの回答に影響する、という仕組みです。確率の話なので「必ず起きる」とは言えません。しかし「絶対に起きない」とも言い切れないのが現状です。

第三者の個人情報や機密情報を含む内容は、このリスクの観点からも入力を避けるべきです。

情報漏洩が起きたとき法的責任を問われるケースも

個人がうっかり自分の情報を入力した場合とは異なり、企業の担当者が業務で第三者の個人情報をChatGPTに入力してしまった場合は話が変わります。

顧客の氏名・住所・メールアドレスなどを本人の同意なくOpenAIに送信することは、個人情報保護法の「第三者提供」に関する規定に抵触するケースがあります。実際に情報漏洩が起きた場合、企業側が損害賠償を求められるリスクも否定できません。

ただし、法的な判断は状況によって大きく異なります。「違反になる可能性がある」という認識を持ちつつ、詳細については法律の専門家に相談することをお勧めします。

ChatGPTで実際に起きた個人情報・機密情報の流出事例

「自分には関係ない」と思っていても、ChatGPTによる情報漏洩は実際に起きています。

それも、大企業の担当者や有料プランの利用者が被害を受けた事例です。「対策すれば防げた」という教訓が各事例に共通しているため、他人事として読むのではなく、自分の使い方を見直すきっかけにしてください。

| 事例名 | 発生時期 | 原因 | 主な教訓 |

|---|---|---|---|

| サムスン機密誤入力事件 | 2023年3月 | 業務効率化目的で社員が機密情報を入力 | 社内ルール・ガイドラインの整備が不可欠 |

| Redisバグによる履歴流出 | 2023年3月 | OpenAIのシステムバグ | 有料プランでも安全性は保証されない |

| ダークウェブでのアカウント売買 | 2025年2月 | マルウェアによる認証情報の窃取 | 多要素認証(MFA)の設定が最低限必要 |

サムスン社員が機密プログラムを誤入力した事件

2023年3月、韓国の大手電機メーカー・サムスンで、複数の社員がChatGPTに機密情報を入力してしまう事件が立て続けに発生しました。

業務の効率化のつもりで、半導体製造に関わるソースコードや社内会議の議事録をChatGPTに貼り付けて処理させたのです。「ちょっと確認してもらいたかっただけ」という感覚で機密情報を送信してしまう、これは多くのビジネス利用者が陥りやすい状況です。

この事件を受けて、サムスン社はその後ChatGPTの社内利用を全面禁止する措置をとりました。組織全体でAIの取り扱いルールを設けていなかったことが、被害を拡大させた背景にあります。社内ガイドラインとして「入力してよい情報・ダメな情報」を事前に明確にしておくだけで、こうした事故は防げたはずです。

バグでチャット履歴が別ユーザーに表示された事件

2023年3月、OpenAIが公式に発表した事件があります。Redisライブラリのバグが原因で、ChatGPT Plusの一部利用者のチャット履歴が、別のユーザーに表示される状態になっていたというものです。

影響を受けたのはChatGPT Plus利用者の約1.2%。約10時間にわたって、他のユーザーの氏名・メールアドレス・クレジットカードの下4桁・会話履歴の一部が見える状態だったと報告されています。有料プランを使っているから安全、という認識が崩れた事例です。

このケースでは個々のユーザーが何かできたわけではなく、プラットフォーム側のシステムバグが原因でした。それでも「有料版でも安全性は絶対ではない」という事実を、利用者として理解しておくことが重要です。機密情報や個人情報の入力範囲を最小限に抑えることが、結果的に最もシンプルなリスク対策になります。

2025年2月に2000万件超のアカウント情報がダークウェブで売買された事例

2025年2月、セキュリティ企業Malwarebytesが衝撃的な報告を発表しました。「emirking」というハンドルネームのユーザーが、2000万件を超えるChatGPTアカウントの認証情報をダークウェブで売り出しているというものです。

原因はOpenAI側のシステム侵害ではなく、マルウェアに感染したユーザーのPCから認証情報が抜き取られたものとされています。つまり「自分のパソコンが安全ならChatGPTのアカウントも安全」とは言えない状況です。アカウントを乗っ取られた場合、過去の会話履歴がすべて見られてしまうという二次被害の怖さがあります。

パスワードだけでの管理は不十分です。この事例を教訓に、ChatGPTのアカウントには多要素認証(MFA)を設定しておくことを強くお勧めします。設定は30秒ほどで完了でき、不正アクセスのリスクを大幅に下げられます。

ChatGPTに絶対に入力してはいけない情報の種類

「何がNGか」を明確に知っておくことが、ChatGPTを安全に活用するためのポイントです。

NGな情報には必ず「なぜNGか」の理由があります。理由を理解しておくと、判断に迷ったときに自分でセーフかどうかを見極められるようになります。

| 情報の種類 | NG例 | セーフな言い換え例 |

|---|---|---|

| 氏名 | 田中花子さんの件で相談したい | Aさんの件で相談したい |

| 会社名・組織名 | 株式会社○○の取引先が… | 某IT企業の取引先が… |

| 財務データ | 今期の売上は1億2000万円で… | 今期の売上は約1億円規模で… |

| ソースコード | (実際の機密コードをそのまま貼り付ける) | コードの構造だけを抽象的に説明する |

| 認証情報 | パスワードはXXXXです、覚えておいて | 入力しない(絶対NG) |

本名・住所・電話番号などの個人を特定できる情報

以下の情報は、個人を特定できる「個人情報」にあたります。ChatGPTへの入力は避けましょう。

- 氏名(本名・フルネーム)

- 住所・郵便番号

- 電話番号・携帯番号

- メールアドレス

- 生年月日・年齢

- マイナンバー・免許証番号

特に注意したいのは「第三者の情報を代わりに入力するケース」です。自分の情報であれば自己責任という側面もありますが、家族・顧客・取引先の情報をChatGPTに送信することは、本人の同意なく第三者のデータを外部サービスに提供することになります。個人情報の取り扱い上、より深刻な問題です。

会社の未公開情報・取引先データ・社内議事録

業務でChatGPTを使う場合、以下の機密情報は入力しないことが原則です。

- ソースコード・システムの設計情報

- 財務データ・売上・損益の数字

- 未発表の製品・サービス情報

- 顧客リスト・取引先の情報

- 社内議事録・会議の内容

「悪意はなかった」「業務効率化のためだった」という意図があっても、情報漏洩になりうる点が怖いところです。前述のサムスンの事例も、社員が意図的に情報を流したわけではなく、業務の手間を省こうとした結果でした。入力した瞬間にOpenAIのサーバーに送信されることを、常に意識しておく必要があります。

クレジットカード番号やパスワードなどの認証情報

以下の認証情報は、絶対に入力してはいけない情報です。

- クレジットカード番号・有効期限・CVV

- ネットバンキングのID・パスワード

- 各種サービスのパスワード・暗証番号

「AIに覚えさせておきたい」「パスワードを整理したい」という目的でこれらを入力してしまうケースが実際にあります。便利さを求める気持ちはわかりますが、認証情報をChatGPTのチャット画面に入力することは、そのままサーバーに送信・保存することと同じです。万が一アカウントを乗っ取られた場合や、システム上のバグが発生した場合に、深刻な二次被害につながります。

入力してもセーフな情報との判断基準

セーフかどうかを判断するには、以下の3点を確認します。

- 特定の個人に紐付かない情報である

- すでに公開情報として誰でも知ることができる内容である

- 匿名化・抽象化済みの情報である

匿名化の具体例を示します。「田中花子さんがこのメールを書いてほしいと言っている」という質問は、「Aさんがこのメールを書いてほしいと言っている」に変えても質問の意図はまったく変わりません。「株式会社〇〇との契約書を添削してほしい」は、「某メーカーとの契約書を添削してほしい」で十分です。

判断に迷ったときは、以下の簡易チェックを使ってください。

- その情報は今すぐネットで調べれば誰でも確認できるか?

- その情報から特定の人物・会社が識別できないか?

- その情報が外部に出ても、誰も困らない内容か?

3つすべてに「はい」と答えられる場合は、概ねセーフと判断できます。

ChatGPTに個人情報を入力してしまった直後の対処法

まず落ち着いてください。以下の順番で対処すれば、被害を最小限に抑えられます。

入力してしまってから時間が経つほど、学習に使われるリスクが高まります。気づいたタイミングで、できる限り早く手を打ちましょう。

| ステップ番号 | やること | 所要時間目安 |

|---|---|---|

| STEP 1 | 問題のチャット履歴を削除する | 入力直後〜5分以内 |

| STEP 2 | メモリ機能に個人情報が残っていないか確認・削除する | 5〜10分以内 |

| STEP 3 | OpenAIプライバシーポータルから削除申請を送る | 10〜30分以内 |

| STEP 4 | 業務上の情報が含まれる場合は上長・情報システム部門に報告する | 当日中 |

まずそのチャット履歴を即座に削除する

問題の会話が含まれるチャット履歴を、まず削除しましょう。

【Web版での削除手順】

- 画面左サイドバーに表示されているチャット履歴の一覧を開く

- 削除したい会話にカーソルを合わせると、右側に「…」メニューが表示される

- 「削除」をクリックし、確認画面で「削除する」を選択する

【スマホアプリ版での削除手順】

- 左上のメニューアイコンをタップしてサイドバーを開く

- 削除したい会話を長押しするか、右端の「…」をタップする

- 「削除」をタップして確認する

ただし、ここで注意が必要です。履歴を削除しても「学習が止まる」わけではありません。OpenAIのサーバー側のデータが即座に消えるわけでもありません。履歴削除はあくまで「自分の画面から見えなくなる」操作です。完全な対処のためには、次のステップが必要です。

OpenAIのプライバシーポータルから削除申請を出す

OpenAIは個人データの削除申請を受け付ける窓口として、プライバシーポータルを設けています。

申請先のURLは privacy.openai.com です。以下の手順で申請を進めてください。

- 上記URLにアクセスして「Make a Privacy Request」をクリックする

- 「I have a ChatGPT account」を選択する

- 要望の種類(削除・訂正など)を選び、該当する情報の内容を記入する

- 登録メールアドレスを確認して申請を送信する

申請後も、即時削除は保証されていません。OpenAIからの回答まで数日〜数週間かかる場合があります。申請が受理されても、技術的な制約からすべてのデータが完全に削除されるとは限らない点も正直に把握しておいてください。

会社や取引先の情報が含まれる場合は上長に報告する

入力してしまった情報に、会社の機密情報や取引先の個人情報が含まれていた場合、これはもはや個人だけで解決できる問題ではありません。

報告の優先順位は、直属の上長→情報システム部門→法務・コンプライアンス部門の順です。「怒られるかもしれない」「大げさかもしれない」という気持ちから黙っていると、後で発覚したときにより大きな問題になります。早期に報告することが、企業と自分自身の両方を守ることになります。

報告の際は「いつ・何の情報を・どのような目的で入力したか」を整理しておくと、対応がスムーズになります。

メモリ機能に個人情報が残っていないか確認する

ChatGPTには「メモリ(Memory)」という機能があります。会話の内容をAIが記憶し、次回以降の回答に反映させる機能です。個人情報を含む会話をした場合、その内容がメモリに保存されている可能性があります。

メモリの確認・削除手順は以下のとおりです。

- 画面右上のアカウントアイコンをクリックして「設定」を開く

- 「パーソナライズ」の項目を選択する

- 「メモリの管理」をクリックして、保存されている内容を確認する

- 個人情報が含まれているメモリがあれば、該当項目の「×」をクリックして削除する

メモリ機能自体をオフにしたい場合は、「パーソナライズ」の画面で「メモリ」のトグルをオフにすれば停止できます。個人情報の取り扱いが心配な場合は、メモリ機能をオフにして運用するのも一つの判断です。

ChatGPTに個人情報を学習させない設定のやり方

設定を変えておくことで、今後の会話が学習に使われるリスクをゼロに近づけられます。

「入力してしまった後の対処」から「今後の予防設定」へ、ここで話が切り替わります。複数のオプトアウト方法を組み合わせることが、最も安全な状態に近づく方法です。

| 方法名 | 対象範囲 | こんな人向け |

|---|---|---|

| 設定画面からモデル改善をオフ | 設定変更以降の会話すべて | 今後の学習を全体的に止めたい人 |

| プライバシーポータルから申請 | 過去の会話データを含む | 過去のデータも含めて除外したい人 |

| 一時チャット機能を使う | その会話のみ | 特定の会話だけ学習させたくない人 |

設定画面の「データコントロール」からモデル改善をオフにする

最も基本的かつ重要な設定です。これをオフにすることで、以降の会話がOpenAIのモデル改善(学習)に使われなくなります。

- 画面右上のアカウントアイコンをクリックして「設定」を開く

- 左メニューから「データコントロール」を選択する

- 「すべての人のためにモデルを改善する」のトグルをオフにする

スマホアプリ版でも同様に「設定」→「データコントロール」から変更できます。1台のデバイスで設定を変更すれば、同じアカウントを使っている他のデバイスにも設定が反映されます。

一時チャット機能を使って特定の会話だけ学習に使わせない

常にオプトアウトの設定を変えるほどではないけれど、「この会話だけは学習に使われたくない」という場面で有効なのが、一時チャット機能です。

新規チャットを開始するとき、画面上部に「一時チャット」というオプションが表示されます。これをオンにした状態で会話すると、その会話は履歴に残らず、学習にも使われません。機密情報や個人情報が含まれる可能性のある質問をするときは、一時チャットを使うのが安全です。

なお、2026年1月のアップデート以降、一時チャット中でもパーソナライズのスタイル設定は引き続き反映されるようになっています。

公式プライバシーポータルで過去データのオプトアウト申請をする

設定画面からの変更は「これからの会話」にしか適用されません。過去のデータも含めて学習から除外したい場合は、プライバシーポータルからの申請が必要です。

申請手順は前のセクション(対処法)で詳しく紹介しています。まだ申請していない方は、そちらを参照してください。

履歴削除だけでは学習が止まらない点に注意する

「履歴を消した=学習が止まった」という誤解は、非常によく見られます。この2つは別々の設定です。

| 設定名 | 何をオフにするか | 学習が止まるか | 履歴が消えるか |

|---|---|---|---|

| 履歴削除(サイドバーから) | 画面上の表示履歴 | 止まらない | 自分の画面からは消える |

| モデル改善をオフ(設定画面) | 学習への使用許可 | 以降の会話は止まる | 消えない |

最も安全な状態に近づけるには、この両方の設定を組み合わせることが必要です。さらに過去のデータが気になる場合は、プライバシーポータルからの申請も加えることで、できる限りリスクを下げられます。

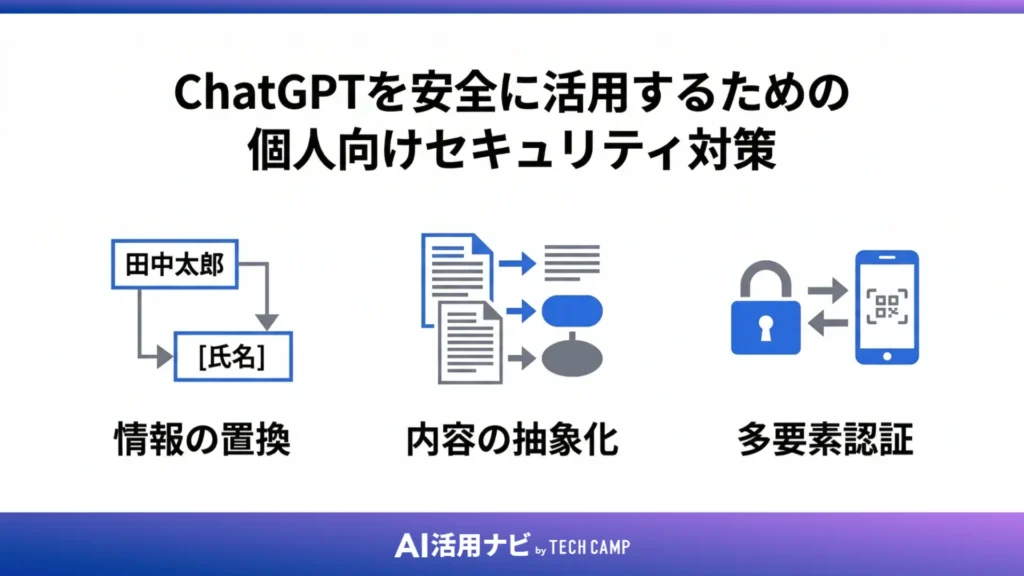

ChatGPTを安全に活用するための個人向けセキュリティ対策

完璧な安全はありませんが、習慣を変えるだけでリスクを大幅に下げることができます。

難しい技術的な知識は必要ありません。「入力前に少し工夫する」「アカウントの設定を確認する」これだけで、個人として取れる対策の大部分をカバーできます。

入力前に個人名・会社名を別の文字に置き換える

最もシンプルで効果的な習慣が、「置き換えてから質問する」というやり方です。

置き換えの具体例:田中花子→Aさん、株式会社〇〇→某メーカー、佐藤部長→上司

Before(NG例):「田中花子さんから届いたクレームメールに対して、丁寧な返信文を作ってください」

After(セーフ例):「顧客Aさんから届いたクレームメールに対して、丁寧な返信文を作ってください」

この置き換えをしても、ChatGPTが返す回答の質は変わりません。個人情報を守りながら、業務の効率化もできます。

具体的な数字や固有名詞を抽象化してから質問する

氏名・会社名だけでなく、具体的な数字や固有名詞も抽象化することで、機密情報の漏洩リスクを下げられます。

売上金額・契約金額・顧客数などは、「1億2,000万円」ではなく「約1億円規模」、「顧客数が423名」ではなく「数百名規模」のように言い換えられます。プロジェクト名も「Project Phoenix」ではなく「某プロジェクト」に変えてから質問しましょう。

抽象化の具体例:「今期売上が1億2,000万円で前期比115%だった理由を分析して」→「今期売上が約1億円規模で前期比2桁成長だった理由を分析して」。質問の意図は変わらず、機密性の高い数字だけが守られます。

アカウントに多要素認証(MFA)を設定する

2025年2月に2,000万件超のChatGPTアカウント情報がダークウェブで売り出された事例からもわかるように、パスワードだけでの管理は十分ではありません。

OpenAIアカウントでのMFA設定手順は以下のとおりです。

- ChatGPT画面の右上のアカウントアイコンをクリックして「設定」を開く

- 「セキュリティ」の項目を選択する

- 「2段階認証」または「多要素認証」のオプションを有効にする

- 認証アプリ(Google AuthenticatorやAuthyなど)をスマートフォンに入れてQRコードを読み込む

30秒ほどで設定できる、最もコストパフォーマンスが高いセキュリティ対策のひとつです。アカウントが万が一乗っ取られても、過去の会話履歴や個人情報が丸見えになるリスクを大幅に下げられます。

今日からできる個人向けの安全対策チェックリストをまとめます。

- モデル改善の設定をオフにしたか

- MFA(多要素認証)を設定したか

- メモリ機能の内容を確認・整理したか

- 個人名・会社名を置き換えてから入力する習慣がついているか

- 機密情報・認証情報は絶対に入力しないルールを守っているか

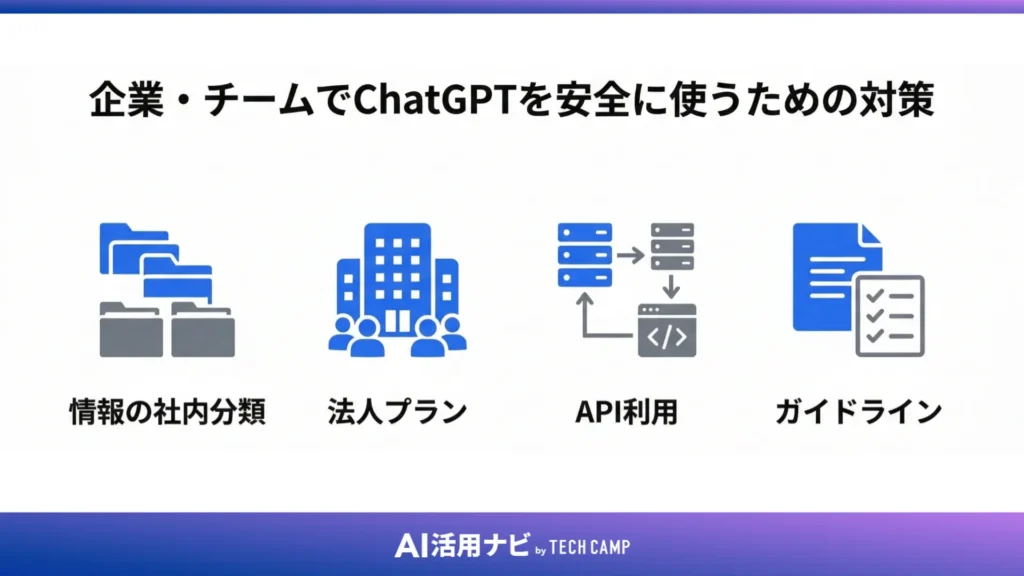

企業・チームでChatGPTを安全に使うための対策

企業での生成AI活用は広がっています。一方で、情報セキュリティの取り扱いルールが追いついていない組織も少なくありません。

「コストをかけずにできること」から始めて、「投資が必要なこと」へ段階的に取り組む流れを整理します。

| 企業規模 | おすすめの対策 |

|---|---|

| 個人事業主 | モデル改善オフ設定+匿名化・抽象化の習慣化+MFA設定 |

| 中小企業 | 上記+社内ルール(3段階分類)の整備+ChatGPT Business導入の検討 |

| 大企業 | 上記+ChatGPT Business/Enterprise導入+API活用+定期的な従業員教育 |

入力してよい情報・ダメな情報を3段階で社内分類する

社内での取り扱いルールを整備する際、情報を3段階に分けて管理するフレームワークがシンプルで有効です。

グリーン(入力OK)の例:公開されている自社の製品情報、一般的なビジネス文書のテンプレート作成依頼、業界全体の動向リサーチ

イエロー(要確認)の例:社内プロセスの一般的な説明、固有名詞を抽象化した業務データ、上長の判断を仰いだうえで使う情報

レッド(絶対NG)の例:顧客の個人情報・連絡先、ソースコード・設計書、未発表の製品・サービス情報、財務データ・売上数字、社内議事録・契約書の内容

この分類表をSlackやNotionの社内チャンネルにテンプレートとして置いておくだけで、ゼロコストで運用を始められます。難しいシステムの導入よりも、まずこの社内ルールから始めることをお勧めします。

ChatGPT Businessプランでデータ学習オフ環境をチーム導入する

ChatGPT Businessプランは、2025年8月29日にTeamプランから名称変更されました。機能・料金は変わらず、名称のみ変更されています。

料金は年払いで月額$25/ユーザー、月払いで月額$30/ユーザーです(2026年3月時点)。チームに10名いれば、年払いで月25,000円程度($250)の投資です。

個人プランとの最大の違いは、デフォルトの状態でデータが学習に使われない点です。個人プランでは自分で設定を変えなければ学習オンのままですが、Businessプランでは管理者が設定を変更しない限り、チーム全員の会話が学習に使われない環境が整っています。

さらに、管理者コンソールでメンバーのアクセス管理ができ、監査ログで利用状況を確認できます。SAML SSOにも対応しているため、社内の認証システムと連携した管理が可能です。セキュリティ要件が高い企業では、Enterpriseプランも検討する価値があります。

API経由で使うことでデータが学習に使われるのを防ぐ

ChatGPTをAPIで利用する場合、データの取り扱いの仕組みが異なります。OpenAIのAPIはデフォルトで「企業が明示的に許可しない限り学習に使われない」オプトイン形式を採用しています。

つまり、API経由でChatGPTを使うシステムを社内に構築すれば、個人プランと同等の機能を使いながら、データが学習に使われない環境を作れます。セキュリティの観点から、大企業やエンジニアリングリソースがある組織にとっては魅力的な候補です。

ただし、API活用にはエンジニアの開発工数が必要です。また、API利用は使った分だけ費用が発生するため、利用量によってはBusinessプランより高コストになる場合もあります。開発リソースがある企業向けの方法として位置づけると良いでしょう。

社内ガイドラインを整備して従業員教育を定期的に実施する

技術的な対策と並んで、人的な対策も欠かせません。ガイドラインに必ず含めるべき項目は以下の5点です。

- ChatGPTへの入力禁止情報の具体的なリスト(レッド情報)

- モデル改善オフ設定・MFA設定の義務化

- 誤入力が発生した際の報告フロー(誰に・いつまでに・何を報告するか)

- 一時チャット機能や匿名化の活用を推奨する旨

- ガイドラインの更新頻度(生成AIは仕様変更が頻繁なため、定期的な見直しが必要)

「ガイドラインを作っても読まれない」という課題はどの企業でも共通です。月次の社内勉強会や、SlackやTeamsの専用チャンネルでの周知を組み合わせることで、形骸化を防げます。

個人情報を安全に活用できるChatGPTの代替・おすすめサービス

ChatGPTに不安を感じている方に向けて、用途やセキュリティ要件によっては他のサービスという候補もあります。

ただし、「ChatGPTが心配だから他を使えばいい」という単純な話ではありません。どのサービスを使うにも、入力内容への注意と適切な設定は必要です。

学習に使われない法人向け生成AIサービス3選

法人向けサービスとして、データが学習に使われない設計の生成AIを3つ紹介します。

まず、ChatGPT Business/Enterpriseです。前述のとおり、デフォルトで学習オフの環境が整っています。OpenAIとの契約上、業務で入力したデータはモデル改善に使われないことが明示されており、企業の情報セキュリティ要件を満たしやすいです。

次に、Azure OpenAI Serviceです。MicrosoftのAzureクラウド上でGPTモデルを使う仕組みです。OpenAIと同じモデルを使いながら、データはMicrosoftのクラウド環境内にとどまり、OpenAI側には渡りません。この違いがセキュリティ上の大きなメリットです。

3つ目に、Google Workspace(Gemini)です。Google WorkspaceのEnterpriseプランでは、Geminiへの入力データが広告目的やモデル学習に使われない契約になっています。すでにGoogleのツールを業務利用している組織には親和性が高いです。

| サービス名 | 学習への使用 | 企業向け管理機能 | 料金目安 |

|---|---|---|---|

| ChatGPT Business | デフォルトでオフ | 管理者コンソール・監査ログ・SSO対応 | $25〜$30/ユーザー/月 |

| Azure OpenAI Service | OpenAIに渡らない | Azure全体の管理機能を利用可能 | 従量課金(公式サイトで要確認) |

| Google Workspace(Gemini) | Enterprise契約でオフ | Google Workspaceの管理機能と統合 | Workspace契約に含まれる |

Azure OpenAI Serviceで社内データを安全に使う方法

Azure OpenAI Serviceは、MicrosoftのAzureクラウド基盤上でOpenAIのGPTモデルを動かすサービスです。

通常のChatGPTとの最大の違いは、「OpenAIのモデルをそのまま使いながら、入力したデータがOpenAIに渡らない」という点です。Azureのセキュリティ環境の中でデータが処理されるため、厳格な情報セキュリティ基準を持つ企業でも導入しやすい構成になっています。

導入にはAzureの契約が必要で、自社のシステムに組み込む際にはエンジニアリングの工数も必要です。個人や小規模事業者が手軽に使えるものではなく、エンジニアリングリソースがある組織向けの方法です。料金は使用量に応じた従量課金制になっているため、詳細はMicrosoftの公式サイトで確認してください。

セキュリティ重視で選ぶ生成AIツールの比較ポイント

生成AIツールをセキュリティ観点で比較・選定する際は、以下の5点を確認しましょう。

- データがモデルの学習・改善に使われるか(オプトアウトの仕組みがあるか)

- 通信・保存時のエンドツーエンド暗号化の有無

- 管理者機能の充実度(ユーザー管理・利用状況の監査ログなど)

- SOC2やISO 27001などのセキュリティ認証の取得有無

- 日本の個人情報保護法・GDPRへの準拠状況

価格だけで選ぶと、後からセキュリティ要件を満たせないことが判明するケースがあります。特に顧客情報を扱う業種(医療・金融・法律など)では、⑤の法的準拠が最優先事項になります。

ChatGPTの個人情報に関するよくある質問

ChatGPTと個人情報について、よく寄せられる疑問をまとめました。

「実はこれも心配だった」という疑問が解消されれば、より安心してChatGPTを活用できるはずです。

- 履歴を削除すれば個人情報はすぐに消えるの?

-

いいえ、すぐには消えません。チャット履歴の削除は「画面上から見えなくなる」操作であり、OpenAIのサーバー側のデータが即座に消去されるわけではありません。履歴削除と学習停止設定はまったく別の機能です。完全なデータ削除を求める場合は、privacy.openai.comのプライバシーポータルから削除申請を別途行う必要があります。

- 無料版(Free・Go)とPlus以上の有料版でデータの扱いは違う?

-

いずれも個人アカウントでは、自分でオプトアウト設定をしなければデータが学習に使われる可能性があります。Free・Go・Plusプランはデフォルトでモデル改善オンの状態です。なお、Goプランは2026年1月に追加された低価格プランです。一方、ChatGPT Business・Enterpriseプランはデフォルトで学習オフのため、企業利用にはこちらが安全です。

- ChatGPTに入力した内容は他の人に見られる?

-

通常は見られません。ただし、以下の3つのケースでは見られる可能性があります。①2023年3月のようなシステムバグが発生したとき、②アカウントが不正に乗っ取られたとき、③OpenAI社内スタッフが安全性確認のために会話を確認するとき。普段の利用で他ユーザーに見られることはありませんが、バグや乗っ取りリスクをゼロにはできない点は認識しておきましょう。

- 企業が個人情報を入力してしまった場合、個人情報保護法に違反する?

-

状況によっては違反になる可能性があります。顧客など第三者の個人情報を本人の同意なくOpenAIに送信することは、個人情報保護法の「第三者提供」に関する規定に抵触するケースがあります。ただし、法的な判断は入力した情報の内容・範囲・目的によって異なります。詳細は法律の専門家にご相談ください。

- 2026年2月に更新されたOpenAIの利用規約では個人情報はどう定められている?

-

2026年2月6日更新のプライバシーポリシーでは、ChatGPTに入力した内容(会話データ)をモデル改善のために使用する場合があると明記されています。ただし、設定画面からオプトアウトすることが可能です。利用規約の全文はOpenAI公式サイト(openai.com)で最新の内容を確認してください。

- ChatGPT以外の生成AIサービスでも個人情報漏洩のリスクはある?

-

はい、程度の差はあれ同様のリスクがあります。GoogleのGeminiやMicrosoftのCopilotも、それぞれのデータポリシーを確認する必要があります。法人向けプランや特定の設定によってリスクを下げられる点はChatGPTと共通しています。どのAIを使うにも、入力する情報に注意する習慣が最も大切です。

ChatGPTに個人情報を入力してしまったときのまとめ

- 問題のチャット履歴を削除する(さらにOpenAIのプライバシーポータルから削除申請も行う)

- 設定画面の「データコントロール」からモデル改善をオフにする(MFA設定も忘れずに)

- 今後の入力ルールを決める(個人名・会社名の置き換え、機密情報は一切入力しない)

ChatGPTに個人情報を入力してしまっても、すぐに深刻な被害が起きるわけではありません。

ただし、入力した時点でデータはOpenAIのサーバーに送信・保存されており、学習に使われる可能性があります。「履歴を削除したから大丈夫」という認識は誤りで、削除と学習停止はまったく別の操作です。

実際に起きた事例を振り返ると、サムスンの機密誤入力事件も、2023年のバグによる履歴流出事件も、2025年のアカウント情報のダークウェブ売買事例も、「対策をしていれば防げた」という教訓が共通しています。ChatGPTを業務で活用する機会が増えた今、セキュリティ対策を後回しにすることのリスクは無視できません。

個人として取れる対策は難しくありません。モデル改善をオフにする設定変更、入力前の匿名化・抽象化、MFAの設定。これらを組み合わせるだけで、リスクを大幅に下げられます。企業であれば、社内の情報分類ルールとガイドラインを整備し、必要に応じてChatGPT Businessプランへの移行や、API活用も検討してください。

正しく使えばChatGPTは業務効率化に大きく役立つツールです。「怖いから使わない」ではなく「リスクを知ったうえで正しく活用する」という姿勢が、生成AIと長く付き合っていくための大切な判断です。